OpenAI于周四推出了GDPval——一个基准测试,旨在定性评估人工智能是否能够完成你的实际工作。

这些不是假设性的考试问题,而是真实的交付成果:法律简报、工程蓝图、护理计划、财务报告——也就是说,这些是能够支付抵押贷款的工作。研究人员故意关注那些至少60%的任务是基于计算机的职业——他们将这些角色描述为“主要是数字化的”。

这一范围涵盖了专业服务,如软件开发人员、律师、会计师和项目经理;金融和保险职位,如分析师和客户服务代表;以及信息行业的工作,从记者和编辑到制作人和音视频技术人员。医疗管理、白领制造角色以及销售或房地产经理也占据了重要位置。

在这一组中,最容易受到人工智能影响的工作与大型语言模型已经能够很好处理的数字化、知识密集型活动重叠:

软件开发,代表了数据集中最大的工资池,尤其脆弱。

法律和会计工作,因其对文档和结构化推理的高度依赖,也位列前茅,金融分析师和客户服务代表同样如此。

内容生产角色——编辑、记者和其他媒体工作者——面临类似的压力,因为人工智能在语言和多媒体生成方面的流利度不断提高。

研究中缺乏手工和体力劳动工作突显了其边界:GDPval并不是为了衡量建筑、维护或农业等领域的影响而设计的。相反,它强调了第一个破坏浪潮可能会首先冲击白领、办公室工作的观点——这些工作曾被认为是最不容易受到自动化影响的。

该报告基于一项两年前的OpenAI/宾夕法尼亚大学研究,该研究声称多达80%的美国工人可能会看到至少10%的任务受到大型语言模型的影响,约19%的工人可能会看到至少50%的任务受到影响。最受威胁(或转变)的工作是白领、知识密集型的工作——尤其是在法律、写作、分析和客户互动领域。

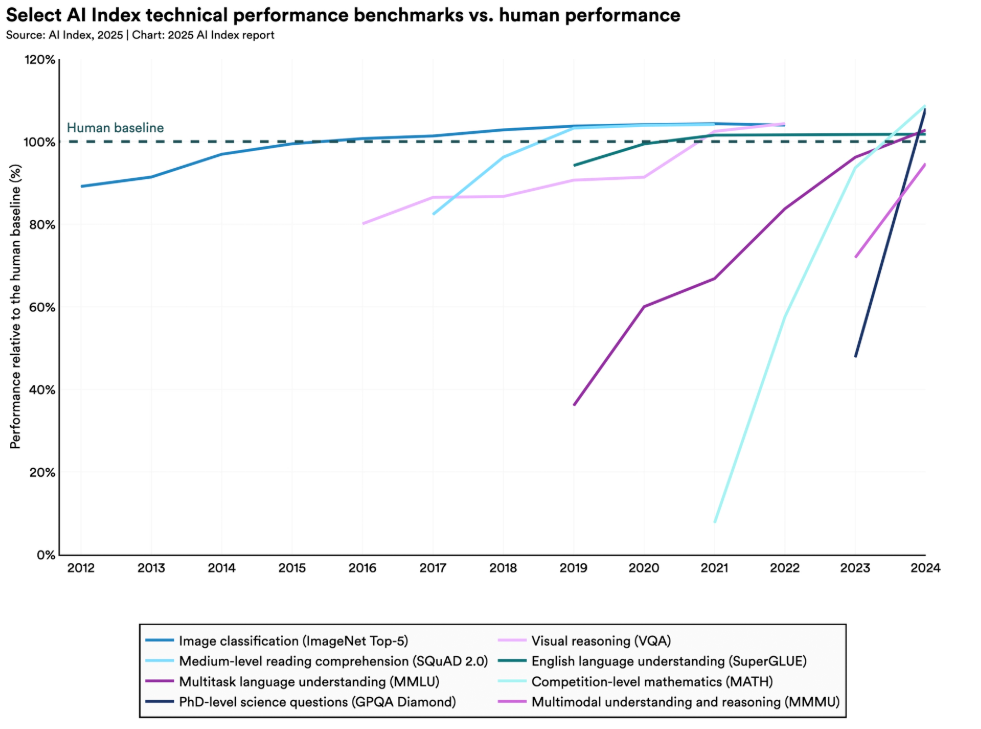

但令人不安的部分不是今天的数字,而是趋势。以这种速度,统计数据表明到2027年,人工智能可能在各个领域与人类专家相匹配。这非常接近AGI标准,可能意味着即使是被认为不安全或过于专业化的任务也可能很快变得可被机器访问,威胁到快速的工作场所转型。

OpenAI测试了1,320个任务,涵盖44个职业——这些不是随机工作,而是推动美国大部分GDP的九个行业中的角色。软件开发人员、律师、护士、金融分析师、记者、工程师:那些认为自己的学位能够保护他们免受自动化影响的人。

每个任务来自平均拥有14年经验的专业人士——不是实习生或应届毕业生,而是熟练的专家,他们了解自己的行业。这些任务也并不简单,平均需要七小时的工作,有些任务甚至需要数周的努力。

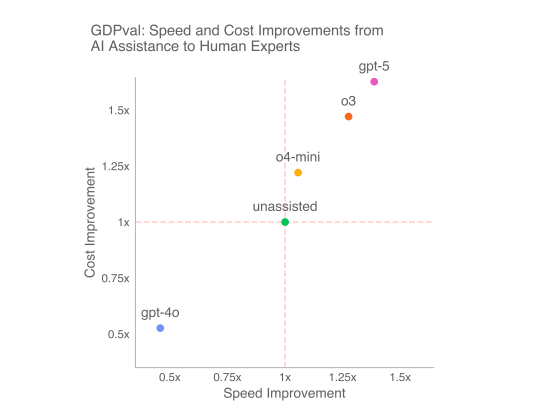

根据OpenAI的说法,这些模型在某些特定API任务中完成这些任务的速度比人类快100倍,并且成本显著更低——这是可以预期的,并且在几十年来一直如此。在更专业的任务上,改进的速度较慢,但仍然显著。

即使考虑到审查时间和偶尔的重做(当AI产生一些奇怪的东西时),经济学也明显倾向于自动化。

但振作起来:工作暴露并不意味着它会消失。它可能会被增强(例如,律师和记者使用大型语言模型更快地写作),而不是被取代。

就人工智能的发展而言,幻觉仍然是企业的一大痛点。研究表明,人工智能在遵循指令方面最常出现失败——GPT-5的35%的损失来自于未能完全理解所要求的内容。格式错误困扰了另外40%的失败。

这些模型在协作、客户互动以及任何需要真正问责的事情上也面临困难,而OpenAI在研究中没有考虑这些。现在还没有人因人工智能的失职而提起诉讼。但对于单独的数字交付成果——填满大多数知识工作者日常的报告、演示和分析——这一差距正在迅速缩小。

OpenAI承认,GDPval今天覆盖的人们在实际工作中执行的任务数量非常有限。该基准无法衡量人际交往能力、身体存在感或使某人超越其交付成果的千个微决策。

尽管如此,当投资银行开始比较人工智能生成的竞争分析与人类分析师的分析时,当医院评估人工智能护理计划与经验丰富的护士的护理计划时,以及当律师事务所测试人工智能简报与助理工作的成果时——这不再是猜测。这是测量。

免责声明:本文章仅代表作者个人观点,不代表本平台的立场和观点。本文章仅供信息分享,不构成对任何人的任何投资建议。用户与作者之间的任何争议,与本平台无关。如网页中刊载的文章或图片涉及侵权,请提供相关的权利证明和身份证明发送邮件到support@aicoin.com,本平台相关工作人员将会进行核查。