今天踩了一个大坑!我怎么不会想到,同一个模型,表现可以差距如此之大!

昨天deepseek 3.2 正式版上线后,能力比肩gpt5。于是我将日常任务的一部分交给了它。它一共负责了30多份分析报告,结果有8份出现严重的问题。

这个结果实在令人意外, 因为离预期相差实在太大。所以今天我接了官方的api接口,又重新跑了一遍。

结果,这次运行结果非常不错。确实有gpt5的水平,跟之前的完全不是一个水平的。

想来想去,问题就出在第一次的openrouter的api。大家知道现在的大模型特别多,如果每家都要注册,充值、还要配置调用代码,特别繁琐。而OperRouter集成了几乎所有的大模型,特别是测试新模型的时候,非常的方便。

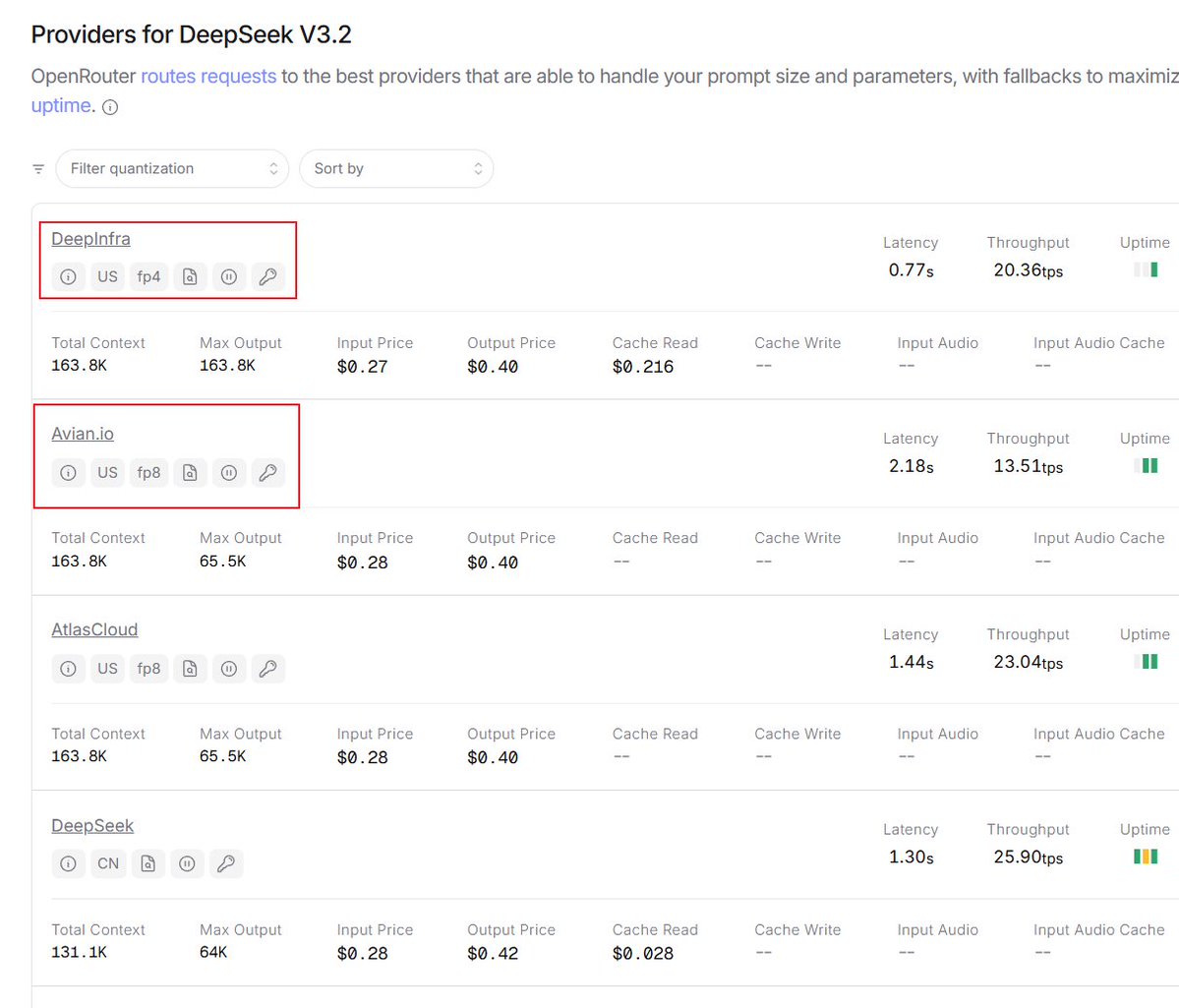

而deepseek V3.2的模型供应商,是提供fp4 fp8。FP4 和 FP8 指的是浮点数(Floating Point)的数据精度格式。简单来说,它们是用来“压缩”模型的技术(即量化),目的是让模型跑得更快、占用的显存更少,同时尽量不损失智能程度。

虽然对大部分模型,fp4 fp8几乎不会损失智能程度。但是deepseek采用的DSA 架构,有可能因此受到比较大的影响。

嘛呀,AI的世界还是太复杂了。

免责声明:本文章仅代表作者个人观点,不代表本平台的立场和观点。本文章仅供信息分享,不构成对任何人的任何投资建议。用户与作者之间的任何争议,与本平台无关。如网页中刊载的文章或图片涉及侵权,请提供相关的权利证明和身份证明发送邮件到support@aicoin.com,本平台相关工作人员将会进行核查。