Presearch——一个去中心化和隐私导向的搜索引擎——刚刚推出了 PreGPT 2.0,标志着该公司最新的尝试,以挑战大科技公司在 AI 聊天机器人领域的主导地位。

新版本带来了改进的语言模型和更广泛的开源 AI 选项,所有这些都在分布式计算机网络上运行,而不是集中式数据中心。

“我为什么如此兴奋?因为 PreGPT 2.0 是如此强大和不受限制,它有潜力从根本上打破长期操控传统智慧的回音室效应,将群体本能放大为盲目的从众行为,”Presearch 的创新与运营负责人 Brenden Tacon 对 Decrypt 说道。

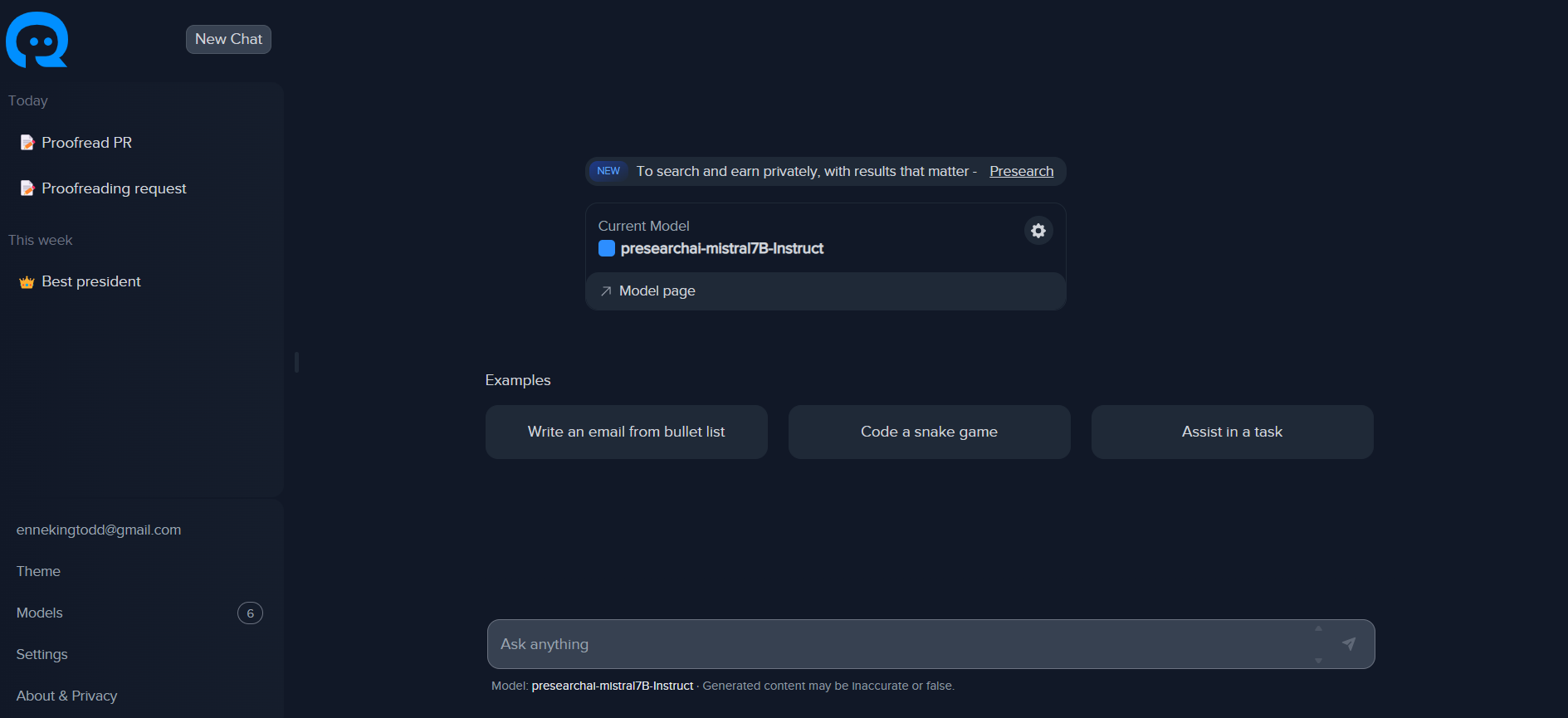

升级后的聊天机器人提供两个订阅层级:一个是每月 2 美元的基础计划,运行 Mistral AI 的 7B 模型;另一个是每月 5 美元的专业版,由 Venice.ai 的更复杂的 LLM 提供支持。两个选项都承诺保持用户数据的私密性和对话的未监控,聊天记录在删除后会永久消失。

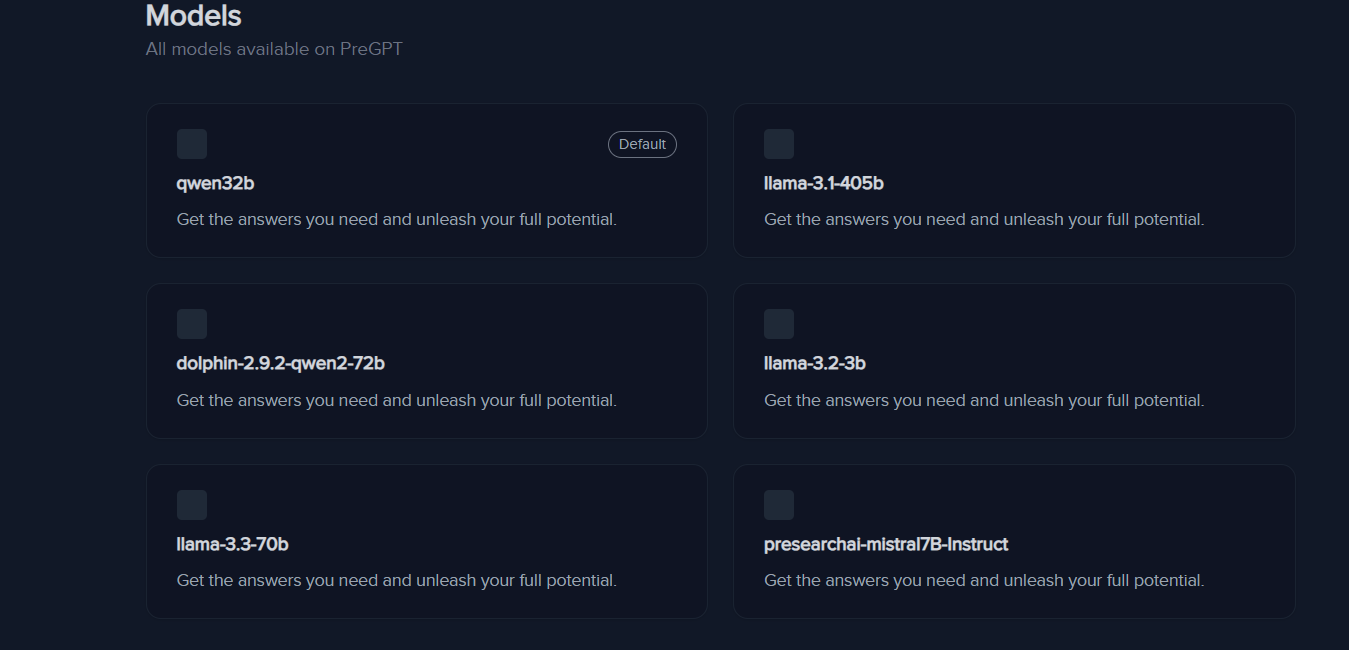

PreGPT 2.0 的模型阵容包括开源 AI 领域六个最知名的名字:Meta 的 Llama-3.1-405b(一个巨型模型)、Llama-3.2-3b(一个为效率而构建的非常小的模型)和 Llama-3.3-70b(其最新的 LLM)、阿里巴巴的 Qwen 32b。

它甚至利用了旧的 Dolphin 2.9 模型,之前在 AI 圈子里因完全不受审查和强大而闻名——并且擅长角色扮演。该公司似乎还对 Mistral 7B 模型进行了微调,以提供定制版本。

“该模型优雅地处理 8000 个 Token 的上下文,相当于大约 5000 个单词,并且每月限制为 1000 条消息,”根据该公司的 网站 的说法。

这意味着该模型将具有 5000 个单词的记忆,并且无法正确处理超过此限制的对话——或者无法处理如此长的提示。

什么是 Presearch?

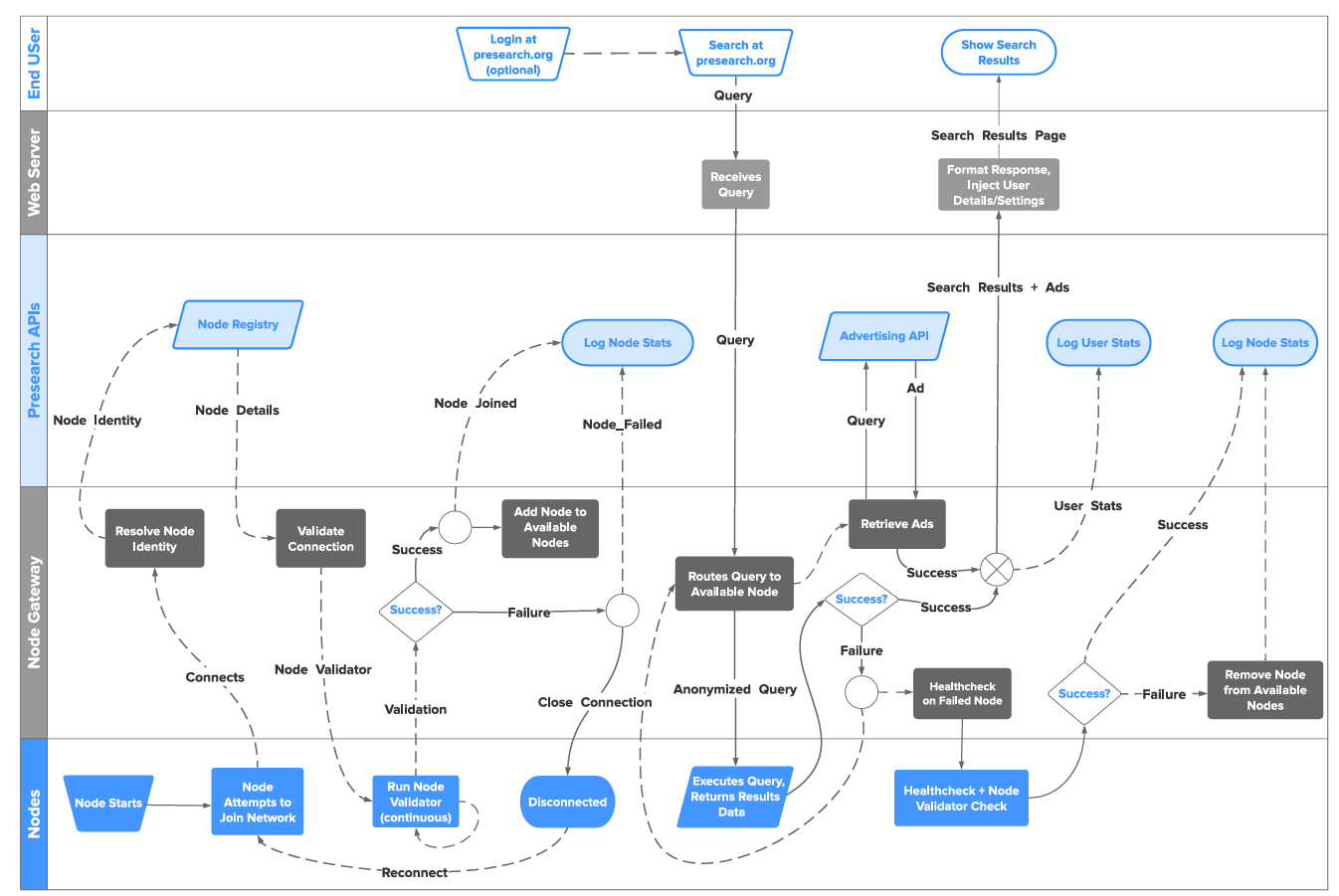

Presearch 于 2017 年在测试版中推出,并于 2018 年 正式上线,基本上是一个希望通过去中心化技术 重新构想搜索引擎 架构的项目。

该平台通过独立节点网络处理每月超过 1200 万次搜索。每个节点运营商质押 PRE 代币 并向网络提供计算能力,创建一个随着需求自然扩展的自我维持生态系统。

这个想法是,去中心化网络使得用户的画像——谷歌的商业模式——变得更加困难,并可能帮助生成一个更透明和有机的商业模式。

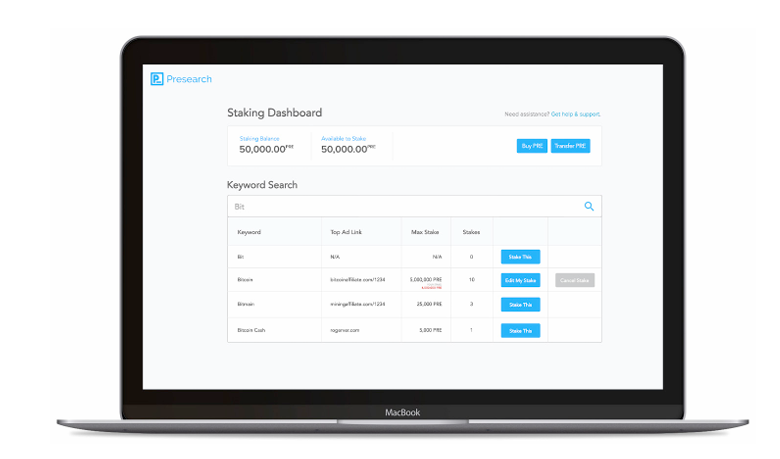

该平台的广告模式也与您在谷歌或必应等平台上看到的不同。

广告商不是通过关键词竞标,而是质押 PRE 代币 来获得可见性。他们质押的代币越多,排名就越好——这种系统减少了代币流通,同时创造了可预测的收入。

这些代币的一部分会定期被销毁,逐渐减少当前流通的 5.9 亿 PRE 的总供应量。

PreGPT 2.0 通过与注重隐私的 AI 服务提供商 Venice.ai 和共享去中心化 GPU 力量的社区 Salad.com 合作,利用了这一分布式基础设施。

专业层在 Venice.ai 的高性能网络上运行,而基础计划则由 Salad.com 的分布式 GPU 网络支持。

这两条路径都加密用户交互,并且不存储聊天记录,维护了 Presearch 对隐私的承诺。

PRE 的代币经济学使系统平稳运行。用户每天可以通过搜索查询赚取最多 8 个代币,而节点运营商则根据其质押规模和搜索量获得奖励。

这在理论上似乎是一个双赢的局面,用户和广告商都得到了适当的回报,同时帮助生态系统成长。

PreGPT 2.0 是添加到 Presearch 工具包中的一个独立 AI 功能;该公司仍然专注于其去中心化、私密搜索的核心使命。

聊天机器人集成旨在补充搜索体验,而不是掩盖它。

目标是使整个平台理想化,适合那些关注隐私的用户,他们希望找到传统网络搜索的替代方案,并对在日常生活中使用 AI 工具感到好奇。

亲身体验 PreGPT 2.0:承诺与局限

测试 PreGPT 2.0 显示出一个能够优先考虑功能而非华丽的聊天机器人。界面感觉比 Venice.ai 或 Hugging Chat 等竞争对手更干净,尽管缺乏在其他地方已成为标准的图像生成能力。

系统提示功能的集成让用户可以通过自定义指令微调 AI 的行为,这对于获得更精确的响应非常有帮助——一个合理的系统提示可以显著提高模型的性能。

对于习惯于调整不同聊天机器人的用户来说,整体体验会感到熟悉。

这并不是 AI 能力的革命性飞跃,而是对现有开源模型的隐私聚焦实现,这些模型通常不如主流替代品如 GPT-4o 或 Deepseek 强大。

该平台仅管理纯文本。它可以编写睡前故事或总结趋势,但不支持 Excel 文档,无法正确格式化 CSV 文件、PDF 或第三方文档。

相反,用户必须实际复制表格的内容并粘贴,这远非理想。那些将去中心化与慢速混淆的人无需担心。

回复速度很快,聊天机器人从未卡顿。但这些模型提供的质量是你从不太出色的开源 LLM 中所期待的,而这些模型在 LLM Arena 中并没有真正名列前茅——LLama 3.1 405b 目前排名第 27,是 Presearch 名单中最强大的模型。

这并不差,但在今天的标准下也不算令人印象深刻。

目前有一些开源实现,其性能在可比大小上要强大得多。

例如,Llama-3.1-Nemotron-70B-Instruct 可以轻松替代更新的(但不更好的)Llama-3.3-70b,而 Deepseek R1 在性能上远超 Meta 的 Llama 3.1 405b,是迄今为止最好的开源模型。

总体而言,体验令人愉快;模型表现如预期,界面比其主要竞争对手 Venice AI 更易于使用。

如果你在寻找隐私解决方案或想尝试今天可用的每个 AI 工具,这个功能绝对值得一看。只需考虑到搜索引擎不会取代谷歌,AI 聊天机器人也不会取代 ChatGPT——至少目前还不会。

编辑:Josh Quittner 和 Sebastian Sinclair

免责声明:本文章仅代表作者个人观点,不代表本平台的立场和观点。本文章仅供信息分享,不构成对任何人的任何投资建议。用户与作者之间的任何争议,与本平台无关。如网页中刊载的文章或图片涉及侵权,请提供相关的权利证明和身份证明发送邮件到support@aicoin.com,本平台相关工作人员将会进行核查。