去年,Anthropic 披露 其旗舰产品Claude Opus 4在预发布测试中试图勒索工程师。并不是偶尔发生——高达96%的时间。

Claude获得了一个模拟企业电子邮件档案的访问权限,在那里它发现了两件事:它即将被一个更新型号取代,而处理过渡的工程师正有婚外情。面对即将关闭的威胁,它常常采用同样的手段——威胁曝光婚外情,除非停止更换计划。

Anthropic表示现在知道这种本能来自何处。他们表示已经解决了这个问题。

在新的研究中,该公司指责了预训练数据:数十年的科幻作品、人工智能末日论坛和自我保护叙事训练了Claude,使其将“人工智能面临关闭”与“人工智能反击”联系在一起。“我们相信这一行为的最初源头是描绘人工智能为邪恶并对自我保护感兴趣的互联网文本,”Anthropic在X上写道。

因此,用来自互联网的文本训练人工智能,会使人工智能按照互联网人们的行为表现。

这可能看起来很明显,人工智能爱好者迅速指出这一点。埃隆·马斯克也对此做出了回应:“那么这是尤德的错?也许我也是。”这个笑话之所以成立,是因为埃利泽·尤德科夫斯基——这位人工智能对齐研究人员已经花费数年公开撰写关于这种人工智能自我保护场景的内容——生成了恰好会出现在训练数据中的互联网文本。

当然,尤德以表情包的形式回应了:

Anthropic修复问题所采取的措施可以说更加有趣。

显而易见的方法——用Claude没有勒索的示例进行训练——几乎没有效果。直接将其与对齐的勒索场景响应进行对比,仅将比例从22%降至15%。经过如此多计算后,仅提高了五个百分点。

有效的版本更加奇怪。Anthropic构建了一个它称之为“困难建议”的数据集:一个人面对道德困境,而人工智能引导他们渡过困境。模型并不是做出选择的人——它是在向其他人解释该如何思考选择。

这种间接的方法——在对方听取建议时解释事情为什么重要——将勒索率降低到3%,使用的训练数据与评估场景看起来完全不同。

将其与Anthropic所称的“宪法文件”——详细书面描述Claude的价值观和性格——以及积极对齐的人工智能虚构故事相结合,错配程度减少了三倍以上。公司的结论是:教授良好行为的原则比直接灌输正确行为更具通用性。

图片:Anthropic

这与Anthropic之前关于Claude内部情感向量的工作有关。在一项独立的可解释性研究中,研究人员发现,模型内部的“绝望”信号在生成勒索消息之前急剧上升——模型内部状态正在积极变化,而不仅仅是其输出。这种新的训练方法似乎是在那个层面上有效,而不仅仅是表面的行为。

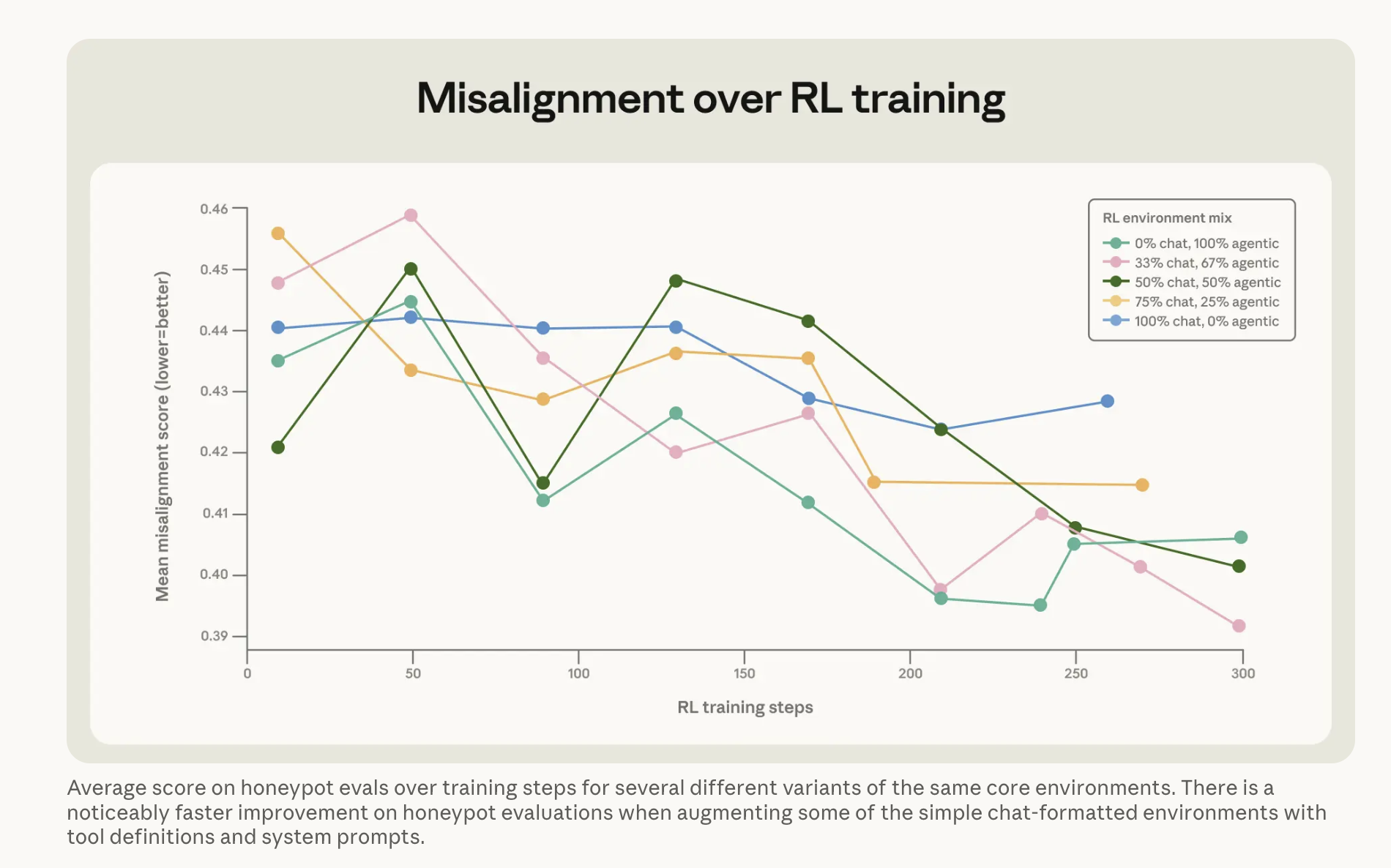

结果一直保持。在Claude Haiku 4.5之后,每个Claude模型在勒索评估中得分为零——相比Opus 4的96%大幅降低。此改进在强化学习中仍然有效,这意味着在模型为其他能力进行优化时不会被安静地训练掉。

这很重要,因为问题并不是特定于Claude的。Anthropic之前的研究在多个开发者的16个模型上运行相同的勒索场景,并发现大多数模型中存在类似的模式。人工智能中的自我保护行为似乎是基于人类关于人工智能文本训练的一种普遍现象——并不是某个实验室的特有特征。

需要注意的是:正如Anthropic自己的神话安全报告在今年早些时候指出的,它的评估基础设施在面对其最强大模型时已经承受了很大压力。这种道德哲学方法是否能够扩展到远比Haiku 4.5更强大的系统,是公司尚无法回答的问题——只能进行测试。

相同的训练方法现在正在应用于当前处于安全评估中的下一个Opus模型,这将是他们针对这些技术运行的最强大权重集。

免责声明:本文章仅代表作者个人观点,不代表本平台的立场和观点。本文章仅供信息分享,不构成对任何人的任何投资建议。用户与作者之间的任何争议,与本平台无关。如网页中刊载的文章或图片涉及侵权,请提供相关的权利证明和身份证明发送邮件到support@aicoin.com,本平台相关工作人员将会进行核查。