- Nvidia 发布了 Nemotron 3 Super,这是一个 120B 参数的开放 MoE 模型,仅在每次前向传播中激活 12.7B 参数。

- 在 8k 输入 / 64k 输出设置下,Nemotron 3 Super 在代理工作负载中提供比 Qwen3.5-122B-A10B 高达 7.5 倍的吞吐量。

- 该模型在 Nvidia Nemotron 开放模型许可证下完全开放,检查点和训练数据在 Hugging Face 上提供。

最新的 Nvidia 模型使用专家混合(MoE)架构,每次前向传播仅激活 12.7 亿参数,这意味着在推理过程中大部分权重保持空闲。这个设计选择直接针对开发者在部署多步骤 AI 代理时遇到的两个问题:扩展推理链的额外成本和在多代理管道中可能增加到 15 倍的令牌使用。

Nemotron 3 Super 是 Nvidia Nemotron 3 系列中的第二个模型,继 2025 年 12 月的 Nemotron 3 Nano 之后发布。Nvidia 于 2026 年 3 月 10 日左右宣布发布。

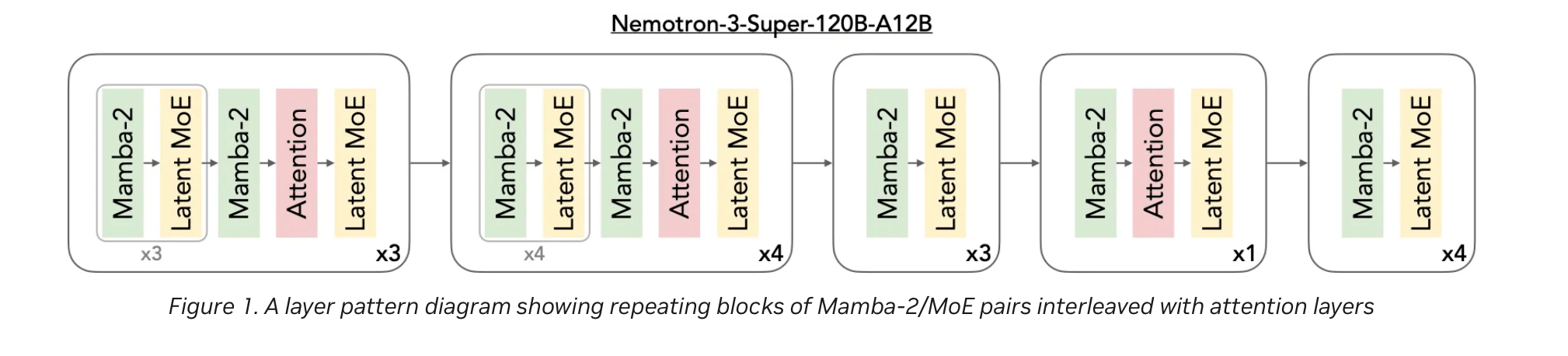

该模型在 88 层中使用混合 Mamba-Transformer 主干。Mamba-2 块以线性时间效率处理长序列,而 Transformer 注意力层则保留准确回忆。这种组合使模型本土支持高达一百万个令牌的上下文窗口,而没有纯注意力设计通常会有的内存惩罚。

Nvidia 还内置了一个 LatentMoE 路由系统,该系统在将令牌嵌入发送到每层的 512 个专家之前,将其压缩到低秩空间中,同时一次激活 22 个。该公司表示,这使得在相同推理成本下,大约有四倍更多的专家,并实现了更细化的任务专业化,例如在专家级别将 Python 逻辑与 SQL 处理分开。

图片来源:Nvidia 博客。

多令牌预测层使用两个共享权重头,加速思维链生成并允许本地推测解码。在结构化任务上,Nvidia 报告生成速度最快可达三倍。

该模型在两个阶段上预训练了 25 万亿个令牌。第一阶段使用了 20 万亿个广泛数据的令牌。第二阶段使用了五万亿个为基准性能优化的高质量令牌。最后的扩展阶段在 51 亿个令牌上扩展了本土上下文至一百万个令牌。训练后包括对大约七百万个样本的监督微调,以及在 21 个环境中进行的超过 120 万次的强化学习。

在基准测试中,Nemotron 3 Super 在 MMLU-Pro 上得分 83.73,在 AIME25 上得分 90.21,在使用 OpenHands 的 SWE-Bench 上得分 60.47。在 PinchBench 上,它达到了 85.6%,在其类别的开放模型中是最高得分。在长上下文评估中,它在 RULER 1M 上得分 91.64。

与 GPT-OSS-120B 相比,Nemotron 3 Super 在 8k 输入和 64k 输出下提供 2.2 倍的吞吐量。与 Qwen3.5-122B-A10B 相对,该数字达到 7.5 倍。Nvidia 还报告说与之前的 Nemotron Super 代相比,吞吐量提升超过五倍,准确性提升高达两倍。

Nvidia 在其 NVFP4 四位浮点格式中端到端训练该模型,专为 Blackwell GPU 优化。在 B200 硬件上,Nvidia 表示推理速度比 H100 上的 FP8 快四倍,没有报告精度损失。量化的 FP8 和 NVFP4 检查点保留 99.8% 或更多的全精度准确性。

该模型还为 Nvidia AI-Q 研究代理提供支持,该代理在 Deepresearch Bench 排行榜上达到了最高位置。

Nemotron 3 Super 在 Nvidia Nemotron 开放模型许可证下完全开放。BF16、FP8 和 NVFP4 格式的检查点,以及预训练数据、后训练样本和强化学习环境,都可以在 Hugging Face 上获取。推理通过 Nvidia NIM、build.nvidia.com、Perplexity、Openrouter、Together AI、谷歌云、AWS、Azure 和 Coreweave 支持,并提供通过 Dell 企业中心和 HPE 的本地选项。

开发者可以通过 NeMo 平台使用 vLLM、SGLang 和 TensorRT-LLM 访问训练配方、微调指南和推理手册。

免责声明:本文章仅代表作者个人观点,不代表本平台的立场和观点。本文章仅供信息分享,不构成对任何人的任何投资建议。用户与作者之间的任何争议,与本平台无关。如网页中刊载的文章或图片涉及侵权,请提供相关的权利证明和身份证明发送邮件到support@aicoin.com,本平台相关工作人员将会进行核查。