如果你一直关注本地的人工智能领域,你可能知道Qwopus——这个开源模型试图将Claude Opus 4.6的推理精华提炼到阿里巴巴的Qwen中,以便你能够在自己的硬件上免费运行类似Opus的东西。效果出乎意料的好。明显的缺陷是:Qwen是一个中国模型,并不是每个人对此都能接受。

Jackrong,这个项目背后的同一个化名开发者,听到了反馈。他的回答是Gemopus——一个全新家族的Claude Opus风格微调模型,完全基于谷歌的开源Gemma 4。全美的DNA,相同的理念:前沿级别的推理,能够在你现有的硬件上本地运行。

这个系列有两种选择。Gemopus-4-26B-A4B是更重的选项——一个混合专家模型,总共有260亿个参数,但在推理时仅激活大约40亿,这意味着在受限硬件上能够超过其应该有的表现。

参数决定了人工智能学习、推理和存储信息的能力。拥有260亿个总参数使得模型的知识面极为广泛。但通过仅“唤醒”与你特定提示相关的40亿个参数,它提供了庞大人工智能的高质量结果,同时又轻量化到足以在日常硬件上顺畅运行。

另一个是Gemopus-4-E4B,一个设计用于在现代iPhone或轻薄MacBook上舒适运行的40亿参数边缘模型——无需GPU。

基础模型的选择在这里很重要。谷歌的Gemma 4于4月2日发布,直接基于与Gemini 3相同的研究和技术——公司在发布时明确表示。这意味着Gemopus拥有Qwen基础的微调模型无法声称的能力:谷歌自身尖端封闭模型的DNA被包裹在Anthropic的思维风格之上。其实是两全其美。

Gemopus与目前涌入Hugging Face的其他Gemma微调模型的不同之处在于其背后的哲学。Jackrong故意选择不将Claude的推理链条压入Gemma的权重——这是大多数竞争发布所采取的捷径。

他的论点得到了近期研究的支持,认为将学生模型填满教师的表面推理文本并不会真正转移真实的推理能力。这教会的是模仿,而不是逻辑。“没有必要过度想象或迷信地复制Claude风格的思维链,”模型卡片上写道。相反,他专注于答案质量、结构清晰度和对话的自然性——修正Gemma生硬的维基百科语气以及它关于你未曾询问的事物的讲解倾向。

人工智能基础设施工程师Kyle Hessling进行了独立基准测试,并直接在模型卡上发布结果。他对26B变体的评估相当积极。“很高兴能为这个模型进行较为严苛的基准测试,结果显示这是对已经出色模型的卓越微调,”他在X上写道。“在长上下文中的一次性请求上表现出色,并且得益于MOE(混合专家)架构,运行非常迅速。”

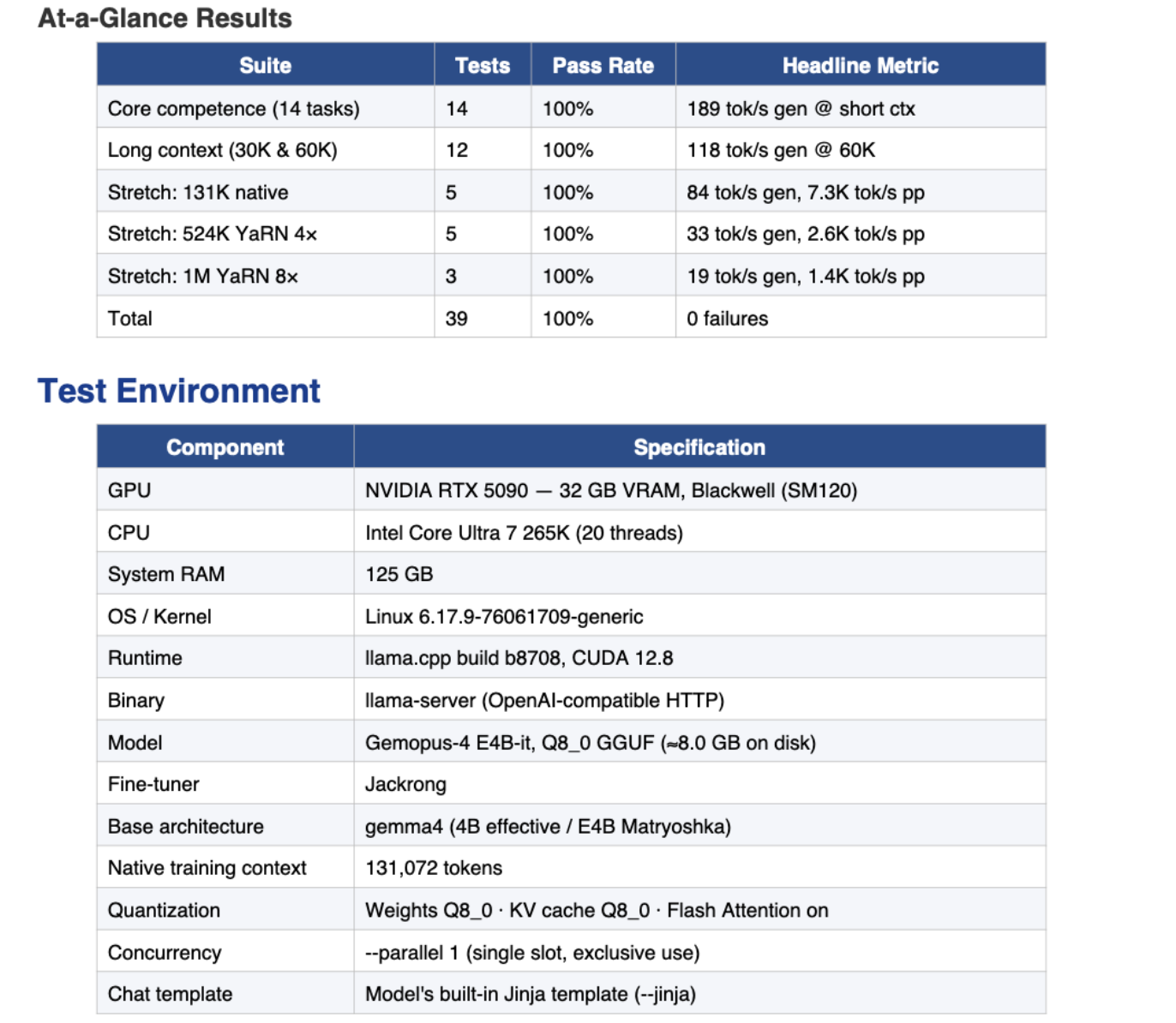

较小的E4B变体通过了所有14项核心能力测试——指令跟随、编码、数学、多步推理、翻译、安全性、缓存——并且在30K和60K标记的长上下文测试中都通过了12项。在针尖找针的检索中,它在13个探针测试中通过了13个,包括在一百万标记范围内的拉伸测试,采用YaRN 8× RoPE缩放。

26B在本地支持131K上下文,并可以通过YaRN扩展到524K,Hessling对此进行了压力测试:“它在扩展到524k的上下文时同样打败了我简单的针尖找针测试!”

在边缘硬件上,E4B确实很快。Jackrong报告在iPhone 17 Pro Max上达到每秒45–60个标记,在MacBook Air M3/M4上通过MLX达到每秒90–120个标记。26B的MoE架构意味着它在小于10GB的显存的统一存储系统或GPU上运行良好。Hessling称其为显存不足系统的日常推荐驱动程序。

这两种模型都以GGUF格式提供,这意味着你可以直接放入LM Studio或llama.cpp,无需配置。完整的训练代码和逐步微调指南可以在Jackrong的GitHub上找到——与他为Qwopus使用的同一管道,使用相同的Unsloth和LoRA设置,可在Colab上重现。

Gemopus并非没有缺陷。工具调用在整个Gemma 4系列的llama.cpp和LM Studio中仍然存在问题——调用失败、格式不匹配、循环——所以如果你的工作流程依赖于使用外部工具的代理,这并不是你的模型。Jackrong本人称其为“工程探索参考,而非完全生产就绪的解决方案”,并建议任何需要更稳定实际工作的用户使用他的Qwopus 3.5系列。

而且由于Jackrong故意避免了激进的Claude风格思维链的提炼,所以不要指望它能像Qwopus那样拥有深邃的Opus思维——那是为了稳定做出的有意识的权衡,而非疏忽。

对于那些想要更深入探索Gemma微调以增强推理能力的人,还有一个值得关注的独立社区项目:Ornstein,由化名开发者DJLougen提供,专注于提高其推理链,而不依赖于任何特定第三方模型的逻辑或风格。

一个诚实的警告:Gemma的训练动态比Qwen的更复杂,微调者的损失波动更大,超参数敏感度更高。Jackrong自己也这么说。如果你需要一个经过更多实战验证的本地模型,以用于生产工作流程,他的Qwopus 3.5系列仍然更为稳健。但如果你想要一个打磨得很好的美国模型,Gemopus是目前最佳的选择。一个更稠密的31B Gemopus变体也在开发中,Hessling调侃它会“绝对是个炸弹”。

如果你想尝试在自己的硬件上运行本地模型,请查看我们关于如何开始本地AI的指南。

免责声明:本文章仅代表作者个人观点,不代表本平台的立场和观点。本文章仅供信息分享,不构成对任何人的任何投资建议。用户与作者之间的任何争议,与本平台无关。如网页中刊载的文章或图片涉及侵权,请提供相关的权利证明和身份证明发送邮件到support@aicoin.com,本平台相关工作人员将会进行核查。