免责声明:本文章仅代表作者个人观点,不代表本平台的立场和观点。本文章仅供信息分享,不构成对任何人的任何投资建议。用户与作者之间的任何争议,与本平台无关。如网页中刊载的文章或图片涉及侵权,请提供相关的权利证明和身份证明发送邮件到support@aicoin.com,本平台相关工作人员将会进行核查。

中国推出的新开源AI模型容量是ChatGPT的两倍。

AI 总结,5秒速览全文

中国开发的一种人工智能(AI)模型在多个方面引起轰动,包括其开源性质以及其处理高达 200,000 个标记的上下文的能力——远远超过其他流行模型,如 [Anthropic 的 Claude](https://wp.decrypt.co/200345/even-the-worst-version-of-claude-ai-is-better-than-gpt-3-5-researchers-say/)(100,000 个标记)或 OpenAI 的 [GPT-4 Turbo](https://wp.decrypt.co/204515/openai-unleashes-gpt-4-turbo-expands-chatbot-customizability/)(128,000 个标记)。

被称为 [Yi 系列](https://huggingface.co/01-ai/Yi-34B "Yi Series"),北京灵翼万物信息技术公司在其 AI 实验室 01.AI 中创建了这个先进的生成式聊天机器人。这个大型语言模型(LLM)有两个版本:轻量级的 Yi-6B-200K 和更强大的 Yi-34B-200K,两者都能够保留巨大的对话上下文,并能够理解英语和普通话。

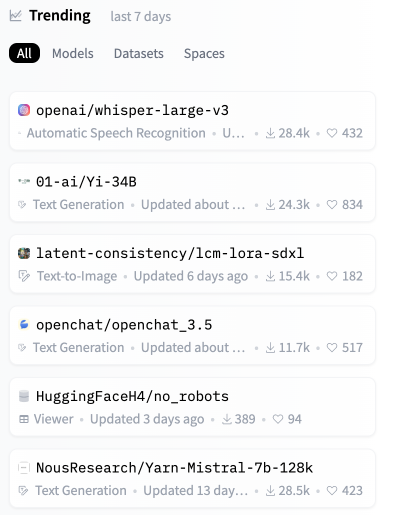

在发布几小时后,Yi 模型迅速上升至 Hugging Face 上第二受欢迎的开源模型,Hugging Face 是 AI 模型的重要存储库。

图片:Hugging Face

尽管 Yi 模型处理了巨大的上下文提示,但它们也非常高效和准确,在几个合成基准测试中击败了其他 LLM。

"Yi-34B 的性能优于更大的模型,如 [LLaMA2-70B](https://wp.decrypt.co/149600/is-metas-chatgpt-killer-really-open-source/) 和 [Falcon-180B](https://wp.decrypt.co/155209/falcon-large-language-model-llm-ai-training-data-set);此外,Yi-34B 的规模可以有效地支持应用程序,从而使开发人员能够构建出色的项目," [01.AI 在其网站上解释](https://01.ai/ "Explains")。根据开发者分享的得分板,最强大的 Yi 模型在阅读理解、常识推理以及高考和 C-eval 等常见 AI 测试中表现出色。

像 Yi 系列这样的大型语言模型(LLM)通过分析和生成基于语言的输出来运作。它们通过处理“标记”或文本单元来工作,这些单元可以是单词或单词的一部分。

有效地说“200K 个标记的上下文”意味着该模型能够理解并回应更长的提示,这在以前甚至会使最先进的 LLM 不堪重负。Yi 系列可以处理包含更复杂和详细信息的广泛提示,而不会崩溃。

然而,最近的第三方分析指出了这一领域的一个限制。当提示占据了 Yi 模型容量的 65% 以上时,它可能会难以检索准确的信息。尽管如此,如果提示的大小远低于这个阈值,Yi 系列模型在导致 Claude 和 ChatGPT 等模型退化的情景中表现出色。

Yi 的一个关键区别在于 [它是完全开源的](https://huggingface.co/01-ai/Yi-6B/blob/main/LICENSE "It Is Fully Open Source"),允许用户在自己的系统上本地运行 Yi。这赋予他们更大的控制权,能够修改模型架构,并避免依赖外部服务器。

"我们预测,AI 2.0 将创造一个比移动互联网大十倍的平台机会,重写所有软件和用户界面," 01.AI 表示。"这一趋势将催生下一波以 AI 为先导的应用和 AI 赋能的商业模式,随着时间的推移,促进 AI 2.0 创新的产生。"

通过开源这样一个功能强大的模型,01.AI 授权全球开发人员构建下一代 AI。在一个可定制的包中处理巨大的上下文,我们可以期待看到大量创新应用利用 Yi。

潜力巨大的开源模型,如 Yi-6B-200K 和 Yi-34B-200K,前景广阔。随着人工智能渗透到我们的生活中,本地运行的系统承诺相比依赖云端的封闭替代方案具有更大的透明度、安全性和可定制性。

尽管 Claude 和 GPT-4 Turbo 夺得头条,这种新的开源替代方案可能很快就会在用户设备上构建人工智能的下一个阶段。就在似乎没有剩余的方法来升级我们的硬件时,也许是时候在你发现本地人工智能被更“上下文感知”的竞争对手超越之前,考虑购买更强大的设备了。

分享至: