深度研究人工智能是今年科技领域最热门的军备竞赛之一。谷歌于2024年12月宣布了其Gemini的研究代理,OpenAI于2025年2月发布了自己的研究代理,xAI 紧随其后,Perplexity加大力度,而Anthropic的Claude在专业人士中建立了忠实的追随者,他们需要详细且有引用的答案,去年四月推出了其代理。

每家公司都在试图说服你,他们的单一人工智能模型是房间里最聪明的研究者。微软刚才表示:为什么只选一个?

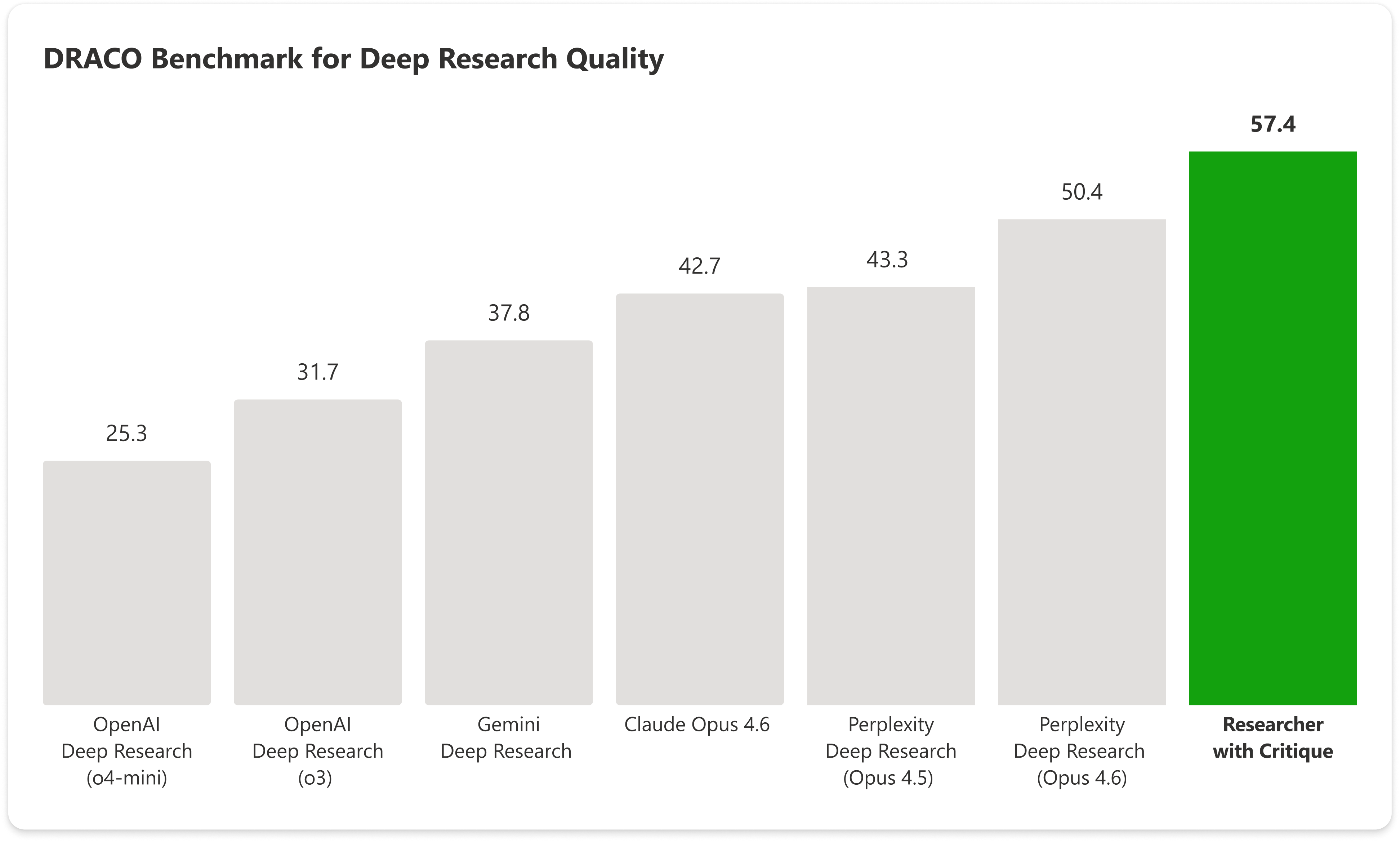

该公司在周一宣布了Copilot的Researcher工具的两个新功能——称为Critique和Council——这使得OpenAI的GPT和Anthropic的Claude在同一个研究任务上顺序工作。根据微软对行业基准的测试结果,这一结果的得分高于测试中包括的所有系统,包括来自顶级人工智能公司的模型。

“Critique是一个新的多模型深度研究系统,旨在处理复杂的研究任务。它将生成与评估分开,并利用来自Frontier实验室的多种模型的组合,包括Anthropic和OpenAI,”微软解释道。“一个模型引导生成阶段,规划任务,反复检索,并生成初步草稿,而第二个模型专注于审查和修订,在最终报告生成之前充当专家审阅者。”

Critique旨在解决的基本问题是:如今的每个人工智能研究工具的工作方式都是一样的。你提出一个问题,一个模型规划搜索,遍历来源,撰写报告,然后交还给你。那个单一模型在做所有事情,没有人检查它的工作。

这可能导致一些幻觉的出现,一些引用中的错误,虚假或不准确的主张等。

Critique将这一工作流程分成了两个阶段。GPT处理第一阶段——它规划研究,提取来源,并撰写初步草稿。然后Claude作为严格的编辑介入,审查报告的事实准确性、引用质量,以及答案是否确实解决了所提出的问题。只有在审查之后,最终报告才会送达用户。微软表示,这些角色最终也可以反向运行,由Claude撰写并由GPT批评,尽管目前还是先由GPT进行。

在DRACO基准测试中——一个涵盖100个复杂研究任务的标准化测试,涉及医学、法律和技术等10个领域——使用Critique的Copilot的得分为57.4,而Anthropic的Claude Opus单独的得分为42.7。微软的组合系统击败了下一个最好结果近14%。

图片:微软

最大的收益体现在分析的广度和展示质量上,事实准确性也有显著改善。

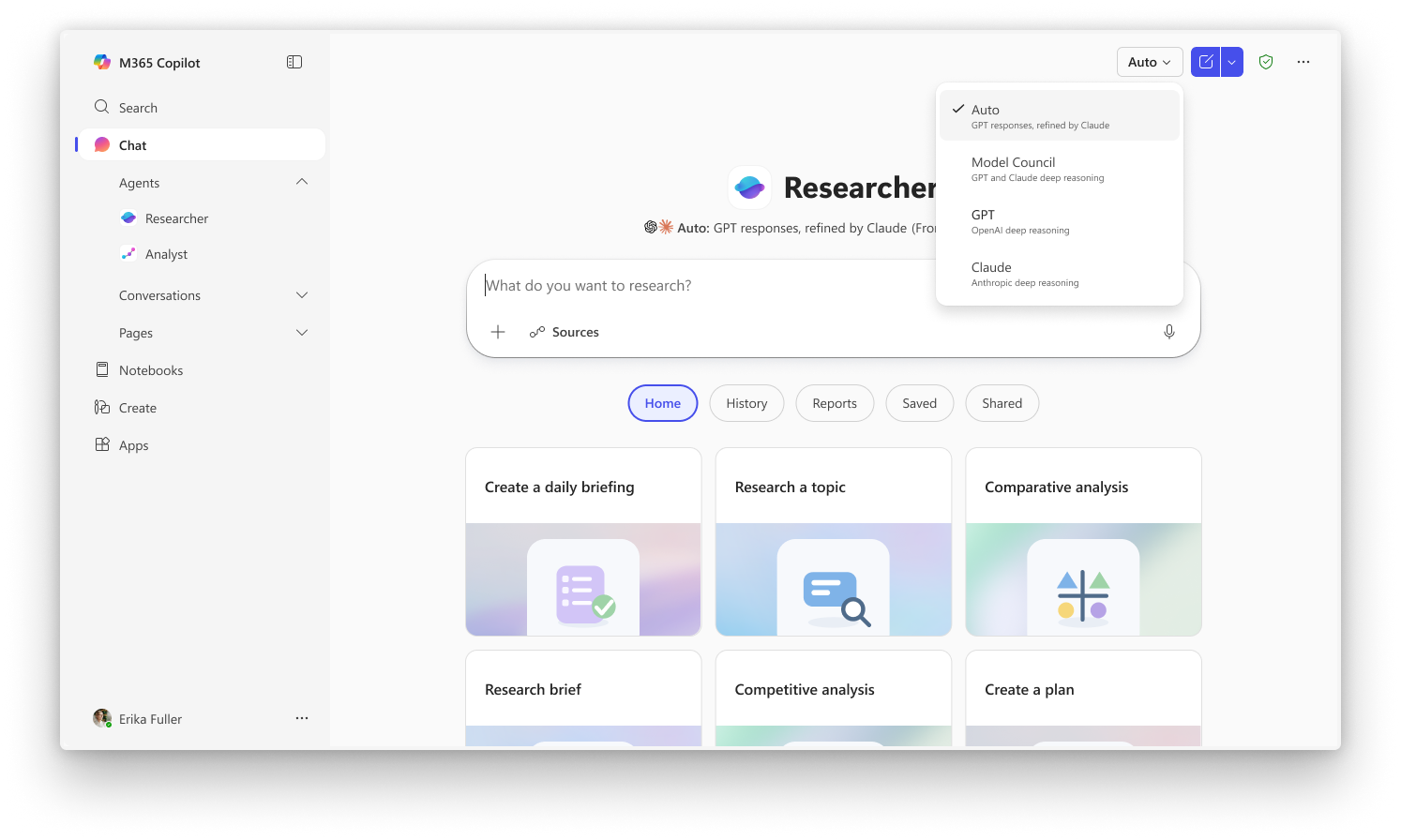

第二个功能,Council,采取了不同的方法来解决同样的问题。它不是让一个模型审查另一个的工作,而是同时运行GPT和Claude,并将它们的完整报告并排放置。第三个“评判者”模型然后读取两个报告,并写一份总结,解释两个人工智能达成一致的地方、分歧的地方,以及每个模型捕捉到的独特角度,而另一个则遗漏了。手动比较人工智能研究工具一直是用户直到现在必须自己完成的事情。

在Critique中,模型本质上是相互合作的,而在Council中,模型则相互竞争。

Critique是Researcher中的默认体验,而Council需要你从选择器中选择“模型委员会”来激活并排模式。两个功能目前对注册了微软Frontier计划的用户开放,这是Copilot最新能力的早期访问渠道。需要一个微软365 Copilot许可证($30/用户/月),但用户还需要注册Frontier才能访问这些功能。

图片:微软

OpenAI和微软有着数十亿美元的合作关系,但微软的赌注在于,没有单一模型会长时间保持在顶端,真正的价值在于协调层,它可以将任务分配给最佳组合。

免责声明:本文章仅代表作者个人观点,不代表本平台的立场和观点。本文章仅供信息分享,不构成对任何人的任何投资建议。用户与作者之间的任何争议,与本平台无关。如网页中刊载的文章或图片涉及侵权,请提供相关的权利证明和身份证明发送邮件到support@aicoin.com,本平台相关工作人员将会进行核查。