来源:华尔街见闻

撰文:鲍奕龙

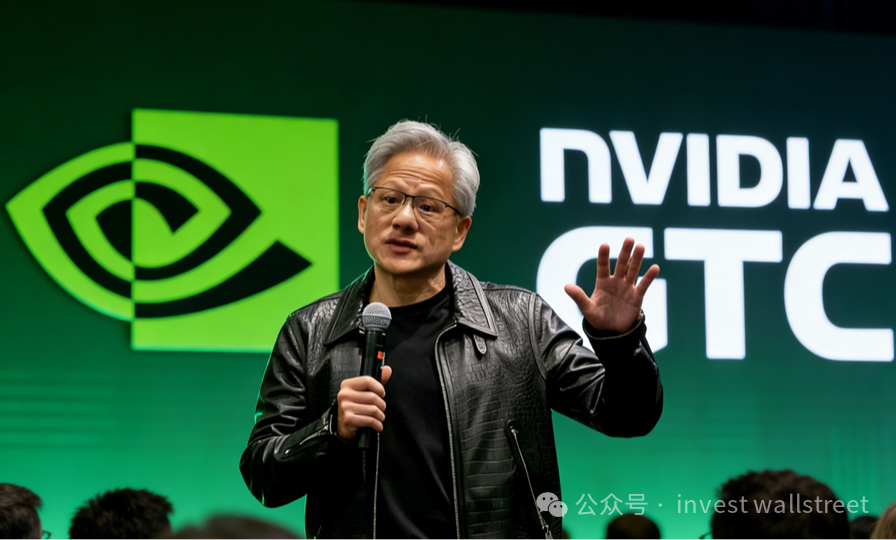

在GTC 2026大会上,英伟达CEO黄仁勋将公司定位为「AI工厂」构建者,称「到2027年将看到至少1万亿美元的高确信度需求」。他提出「Token工厂经济学」,强调每瓦性能是商业变现的核心。黄仁勋断言Agent(智能体)将终结传统SaaS模式,未来「年薪+Token预算」将成为职场新标配。

开场致辞

主持人: 欢迎英伟达创始人兼首席执行官黄仁勋登台。

黄仁勋,创始人兼首席执行官:

欢迎来到GTC。这是一场技术大会,看到这么多人一大早就排队入场,非常高兴。

今天我们将围绕三大平台展开讨论:CUDA-X平台、系统平台,以及全新的AI工厂平台。当然,最重要的是生态系统。

首先,我要感谢我们的"赛前热身"主持人,他们表现出色:来自Conviction的Sarah Guo、红杉资本的Alfred Lin(英伟达的第一位风险投资人),以及英伟达第一位重要机构投资人Gavin Baker。这三位对技术有着深刻的理解,在技术生态系统中拥有广泛的影响力。此外,也感谢我亲自挑选的所有贵宾。

同时,我要感谢所有参会企业。英伟达作为平台公司,拥有技术、平台和丰富的生态系统。今天,涵盖百万亿美元产业的企业几乎全部汇聚于此——450家企业赞助了本次活动,非常感谢。

本次大会共设1,000场技术专题,汇聚2,000位演讲嘉宾,将覆盖人工智能"五层蛋糕"的每一层——从土地、电力与基础设施,到芯片、平台、模型,以及最终推动整个产业腾飞的各类应用。

CUDA的20年历程

今年是CUDA诞生20周年。

20年来,我们始终致力于这一架构——这项革命性的发明:SIMT(单指令多线程),允许标量代码衍生为多线程应用,比传统方式更易于编程。近年来,我们还新增了Tiles(瓦片)支持,帮助开发者更便捷地对Tensor Core及当今AI数学结构进行编程。

迄今为止,CUDA已积累了数千种工具、编译器、框架与库,在开源社区中拥有数十万个公开项目,并已深度集成至每一个主流生态系统中。

飞轮效应与安装基础

下面这张图,基本上描述了英伟达战略的全貌。

最难实现、也最具战略价值的,是底层的安装基础。历经20年,我们在全球构建了数亿颗运行CUDA的GPU和计算系统。我们覆盖了每一家云服务商和每一家计算机厂商,服务于几乎每一个行业。

CUDA的安装基础,正是飞轮加速的根本原因。 庞大的安装基础吸引开发者,开发者创造新算法,新算法催生突破——例如深度学习的诞生。这些突破开辟全新市场,新市场汇聚更多生态伙伴,进而形成更大的安装基础。这一飞轮正在持续加速。

目前,英伟达库的下载量正以惊人速度增长,且增速仍在不断提升。这一飞轮使得计算平台能够持续支撑海量应用和层出不穷的技术突破。

更重要的是,它也使基础设施拥有了极长的使用寿命。原因很简单:英伟达 CUDA能运行的应用范围极广,覆盖AI生命周期的每个阶段、每种数据处理平台,以及各类科学原理求解器,因此一旦安装英伟达 GPU,其使用寿命便极为可观。

这也解释了为什么我们六年前发布的Ampere架构,其云端定价至今仍在上涨。

与此同时,随着我们持续更新软件,计算成本也在不断下降——这不仅体现在初次部署时的性能跃升,更体现在加速计算带来的长期持续降本效应。由于所有GPU在架构上互相兼容,我们愿意持续支持和维护全球每一块GPU。安装基础越大,每次新优化所惠及的用户就越多。

这一动态组合,使英伟达架构在扩大覆盖范围、加速增长的同时,持续压低计算成本,从而反过来推动新一轮增长。

CUDA的起点:GeForce

CUDA的旅程,实际上始于25年前的GeForce。

GeForce是英伟达有史以来最成功的市场营销。我们从你们还年幼、尚未具备消费能力时就开始吸引未来的客户——那时是你们的父母在为你们买单,年复一年,直到有一天你们成长为出色的计算机科学家,成为真正的开发者。

25年前,我们发明了可编程着色器——世界上第一款可编程加速器,也是像素着色器的起点。这一发明驱动我们不断深入探索,5年后催生了CUDA。

将CUDA从GeForce推广到每一台计算机,是我们当时最重大的投资之一——即便当时难以负担,它也消耗了公司绝大部分利润。我们坚信其潜力,尽管初期艰辛,但经过20年、13代架构的坚守,CUDA如今已无处不在。

大约8年前,我们推出了RTX,对架构进行了彻底重新设计,引入了两项当时全新的理念:硬件光线追踪与AI驱动的图形渲染。就如同GeForce将AI带到了世界面前——让Alex Krizhevsky、Ilya Sutskever、Geoffrey Hinton、Andrew Ng等人发现GPU是加速深度学习的利器,从而点燃了AI的大爆炸——如今,AI也将反过来彻底革新计算机图形学。

神经渲染:DLSS 5

今天,我要向大家展示图形技术的未来。我们称之为神经渲染——3D图形与人工智能的融合,这就是DLSS 5。

效果震撼,对吧?我们将可控的3D图形(虚拟世界的"结构化数据")与生成式AI(概率计算)融合在一起:一个完全可预测,另一个概率驱动却高度逼真。两者结合,生成的内容既美观、逼真,又完全可控。

结构化信息与生成式AI的融合,将在一个又一个行业中不断重演。结构化数据,是可信AI的基石。

结构化数据与非结构化数据平台

接下来这张图可能会让你们有些震惊,但请耐心听我说完。

结构化数据——SQL、Spark、Pandas、Velox,以及Snowflake、Databricks、Amazon EMR、Azure Fabric、Google BigQuery等重要平台——都在处理数据框(Data Frame)。这些数据框本质上是巨型电子表格,承载着所有业务信息,是企业计算的"基准事实"。

在AI时代,这些结构化数据将被AI高速调用,因此必须被极致加速。未来的AI Agent也将广泛使用结构化数据库。

非结构化数据则代表着世界上绝大多数的信息:向量数据库、PDF、视频、语音……全球每年生成的信息中,约90%都是非结构化数据。过去,这些数据几乎毫无用处——我们将它们存入文件系统,却无法检索、无法查询。

现在,AI改变了这一切。就像AI解决了多模态感知与理解问题,同样的技术可以读取PDF、理解其含义,并将其嵌入可检索、可查询的更大结构中。

为此,英伟达创建了两个基础库:

cuDF:用于数据框(Data Frame)和结构化数据加速

cuVS:用于向量存储(Vector Store)、语义数据和非结构化AI数据加速

这两个平台将成为未来最重要的计算平台之一。

今天,我们正式宣布多项合作:

IBM(SQL的发明者)正在使用cuDF加速其WatsonX数据平台

戴尔与我们合作打造了Dell AI数据平台,整合cuDF与cuVS,专为AI时代设计

Google Cloud:我们加速其Vertex AI和BigQuery平台;以Snapchat为例,我们帮助其将计算成本降低了近80%

AWS:我们加速EMR、SageMaker和Bedrock,并将把OpenAI引入AWS,推动其大规模云计算消费

Microsoft Azure:我们加速Azure AI Foundry,深度支持必应搜索,并扩展Azure区域部署

CoreWeave:全球第一家AI原生云,为GPU托管和AI推理而生

Oracle:我们是Oracle的第一位AI客户

Palantir + 戴尔:三方合作,可在任意国家、任意隔离区域、完全本地化地部署AI平台

英伟达的核心战略:垂直整合,水平开放

英伟达是全球首家垂直整合、同时水平开放的计算公司。

加速计算不是一个芯片问题,也不是一个系统问题,其核心是应用加速。要持续为每个应用领域带来显著加速和成本降低,就必须深入理解应用、理解领域、理解算法,并在每一种部署场景中落地实施——无论是数据中心云端、本地部署、边缘计算还是机器人系统。

这就是英伟达必须深耕一个又一个垂直领域的原因。我们在理解算法的基础上,将其整合进计算平台,开放给全世界使用。

本届GTC几乎涵盖了英伟达生态的每一个垂直领域,包括:

自动驾驶

金融服务(本次GTC与会者中占比最大的行业,希望来的是开发者,不是交易员)

医疗健康(正经历其"ChatGPT时刻")

工业制造

娱乐与游戏

机器人(110台机器人参展,几乎每家机器人公司都在与英伟达合作)

电信(约2万亿美元规模的行业,基站将演变为AI边缘计算基础设施)

我们在本届大会上宣布100个库和约40个模型的更新。这些库是公司的核心资产,是激活计算平台、解决实际问题的关键。

其中最重要的库之一是cuDNN(CUDA深度神经网络库),它彻底革命性地改变了人工智能,点燃了现代AI的大爆炸。

推理拐点的到来

过去两年里,究竟发生了什么?三件大事推动了这一切:

第一:ChatGPT与生成式AI时代的开启(2022年底至2023年)。 AI不仅能感知与理解,还能翻译、创作,生成全新内容。生成式计算从根本上改变了计算机的架构方式与建设逻辑。

第二:推理AI的崛起(o1及o3模型)。 推理AI使模型能够反思、规划,将复杂问题分解为可处理的步骤,让AI更加值得信赖,并扎根于事实。这使ChatGPT的使用量急剧攀升,同时也大幅增加了输入与输出Token的计算量。

第三:Claude Code与Agentic AI的诞生。 这是第一个真正意义上的Agentic模型,能够读取文件、编写代码、编译、测试、评估,并迭代优化。Claude Code彻底革新了软件工程。如今英伟达内部,每一位软件工程师都在使用AI Agent辅助编程。

AI经历了从"感知"到"生成",从"生成"到"推理",再从"推理"到"执行"的演进历程——如今的AI能够完成真正富有成效的工作。

推理拐点已然到来。 AI每次思考、执行、读取、推理,都需要进行推断(Inference),Token生成需求呈爆炸式增长。过去两年间,单次工作的计算需求提升了约10,000倍,使用量提升了约100倍,计算总需求的增幅接近100万倍。

从5000亿到1万亿美元

去年GTC上,我提到我们看到了至2026年、对Blackwell和Rubin约5000亿美元的高可信度需求。

今天,在GTC整整一年后,站在当下,我可以清晰地看到:至少到2027年,需求将达到1万亿美元。

而且,我确信实际计算需求将远高于此。

去年是英伟达的推理之年。我们全力确保在训练和后训练之外,在AI生命周期的每个阶段都表现卓越,从而使基础设施投资能够长期持续发挥价值。

我们也很高兴看到Anthropic选择了英伟达,Meta SL也选择了英伟达。当前,开源模型已接近前沿水平,并已无处不在。英伟达是目前全球唯一能够在语言、生物学、计算机图形学、计算机视觉、语音、蛋白质与化学、机器人等所有AI领域,跨所有AI模型,覆盖边缘到云端全场景的计算平台。

我们架构的"可迁移性(Fungibility)",使其成为构建AI基础设施时最低成本、最高置信度的平台。当你投入万亿美元建设基础设施时,你需要完全的信心——英伟达是目前全球唯一能够让你充满信心部署的计算平台,无论是云端、本地还是任何国家。

目前,我们60%的业务来自五大超大规模云服务商,另外40%来自区域云、主权云、企业、工业、机器人、边缘和超算等多个领域。这种多元化的覆盖本身就是韧性所在——AI已不再是单一应用,而是一场真正意义上的计算平台转变。

推理性能的突破

我们在推理优化上取得了根本性突破:

这是有史以来最全面的AI推理性能测评(来自Semi Analysis)。分析维度如下:

纵轴(每瓦Token数):反映吞吐量。每个数据中心都受电力约束,1吉瓦的工厂无法变成2吉瓦,必须在有限电力内最大化Token产出。

横轴(推理速度/Token速率):反映交互性与AI"智能度"。速度越快,模型越大、上下文越长、思考越深——也就越"聪明"。

结果令人震惊:

从Hopper H200到Grace Blackwell,摩尔定律预期能带来约1.5倍的提升,但实际提升达到35倍的每瓦性能。Semi Analysis的Dylan Patel甚至指出我报告的数据过于保守——实际上是50倍。

这意味着英伟达的每Token成本是全球最低。一个吉瓦数据中心建设成本约400亿美元(摊销15年),无论如何都必须付出这笔固定成本——因此必须在其上安装性能最优的计算系统,才能实现最低的Token成本。这一点,目前无可匹敌。

以Fireworks AI为例:我们更新了他们的软件后,同一套系统的Token速率从约700 tokens/秒提升至近5,000 tokens/秒,提升了7倍。这就是极致协同设计的威力。

Token工厂的商业逻辑:

未来每家云服务商、AI公司都将从Token工厂的视角审视其业务。不同Token速率对应不同服务等级与定价:

免费层:高吞吐、低速度

基础层:约3美元/百万Token

标准层:约6美元/百万Token

高级层:约45美元/百万Token

顶级层:约150美元/百万Token(高速、超长上下文、最大模型)

以Grace Blackwell为例:与Hopper相比,在最具商业价值的服务层级,其吞吐量提升了35倍,可大幅增加可变现容量,将整体数据中心收益提升约5倍。

Vera Rubin:下一代架构

现在,我不再只展示一颗芯片——我展示的是整个系统。这就是Vera Rubin。

Vera Rubin专为Agentic系统设计,其核心逻辑非常清晰:

大型语言模型将越来越大,需要生成更多Token、更快速地思考;

AI Agent将频繁访问内存(KV Cache)、结构化数据(cuDF)和非结构化数据(cuVS);

存储系统将承受巨大压力;

工具调用要求CPU具备极高的单线程性能。

为此,我们打造了全新的Vera CPU——全球唯一使用LPDDR5的数据中心CPU,兼具极高单线程性能、出色数据处理能力和无与伦比的能效比。

Vera Rubin系统的核心特性:

100%液冷,所有线缆大幅简化

安装时间从两天缩短至两小时

使用45°C热水冷却,大幅降低数据中心冷却能耗

搭载第六代NVLink交换系统(全球唯一)——完全液冷,极难实现,我为团队感到无比自豪

全球首款CPO Spectrum-X交换机(共封装光学)已量产:光子直接集成至芯片,电子信号转换为光子,直接连接至芯片。该工艺与台积电联合研发,我们是全球唯一量产者,称为"CoOP",彻底革命性。

各系列CPU也进入量产,已确定将成为数十亿美元规模的独立业务

Rubin Ultra(超级版):

Rubin Ultra采用全新"Kyber"机架,支持144颗GPU构成单一NVLink域。计算节点从正面插入,NVLink交换机从背面通过中板连接,整体构成一台巨型计算机。

在技术路线图方面:

Blackwell(当前):Oberon系统,支持NVLink 72

Vera Rubin:Kyber机架(NVLink 144)+ Oberon铜缆/光学扩展至NVLink 576

Vera Rubin Ultra:Rubin Ultra芯片 + LP35(首次引入NVFP4计算结构)

Feynman(下一代):全新GPU + LP40 + Rosa CPU(Rosalyn简称)+ Bluefield 5 + CX 10 + 铜缆与CPO双模扩展

Grok收购与异构推理突破

我们收购了Grok的技术团队,并获得了技术授权,进行深度集成。

Grok处理器的核心特点:

确定性数据流处理器,静态编译,由编译器调度计算

计算与数据同时到达,完全软件调度,无动态调度

拥有海量SRAM,专为推理这一单一工作负载设计

其局限在于:单颗Grok芯片仅有500MB存储(相比之下,单颗Rubin芯片有288GB),无法容纳大型模型的参数及KV Cache,限制了其规模化能力——直到我们有了一个绝妙的想法。

Dynamo:推理解耦框架

我们开发了Dynamo软件,将推理流程重新架构:

预填充(Prefill)阶段:在Vera Rubin上执行(需要大量算力)

解码(Decode)阶段的Attention计算:在Vera Rubin上执行(需要大量算力)

解码阶段的前馈网络(FFN)/ Token生成:在Grok芯片上执行(需要大带宽、低延迟)

两款架构截然不同的处理器——一个专为高吞吐量,一个专为低延迟——通过Dynamo紧密耦合,延迟降低约50%。

结果:在最具商业价值的服务层级,性能提升35倍,同时开辟了此前从未有过的全新推理性能层级。

Grok LP30由三星代工制造,目前已投入量产,预计2026年第三季度开始出货。

Grok的最优部署策略:

若工作负载以高吞吐量为主:100% Vera Rubin

若有大量高价值代码生成或高速Token需求:建议将25%算力配置为Grok,其余75%保持Vera Rubin。

AI工厂规模与展望

在一个吉瓦级工厂中,仅用两年时间,通过上述架构优化,Token生成速率将从2200万提升至7亿,提升幅度350倍。

这就是极致协同设计的力量——垂直整合、水平开放,让所有人共享这一成果。

随着AI工厂规模急剧扩张,我们发现一个关键问题:数据中心中各类技术供应商过去从未互相接触,各自独立开发,导致大量能源浪费。

为此,我们创建了英伟达 DSX平台,基于Omniverse,让所有合作伙伴能够在虚拟世界中共同设计吉瓦级AI工厂——涵盖机械、热管理、电气、网络的全系统仿真,并与电网实时互联,通过Max-Q技术动态优化功耗与冷却。

我们相信,仅这一平台就能释放约两倍的效率提升——在万亿美元规模下,这是极其巨大的价值。

此外,英伟达还将进军太空:Thor芯片已通过辐射认证,部署于卫星之中。我们正与合作伙伴开发Vera Rubin Space-1,在太空中建设数据中心(需解决纯辐射散热的工程挑战)。

OpenClaw:AI Agent的操作系统

现在谈谈一个重大新发现。

Peter Steinberger开发了一款软件,叫做OpenClaw。它成为了有史以来最受欢迎的开源项目,在短短几周内超越了Linux三十年来的传播速度。

OpenClaw是什么? 它是一个Agentic系统,能够:

连接大型语言模型

访问工具和文件系统

执行调度和定时任务

将问题分解为逐步执行的子任务

生成并调用子Agent

支持多模态交互(文字、语音、手势等)

换言之,OpenClaw本质上是Agentic计算机的操作系统。就像Windows使个人电脑成为可能,OpenClaw使个人Agent成为可能。

每家企业的关键问题已变为:你的OpenClaw战略是什么?

就像曾经每家公司都需要Linux战略、HTTP/HTML战略、Kubernetes战略,今天每家公司都必须有OpenClaw战略和Agentic系统战略。

企业IT的范式转变:

旧模式:数据中心存储文件 → 软件工具 → 人类使用工具

新模式:每一家SaaS公司都将成为AaaS(Agentic as a Service)公司,提供专业化的Agent服务。

然而,企业内部的Agentic系统存在重大安全挑战:它可以访问敏感信息、执行代码、对外通信。为此,我们与Peter Steinberger合作,联合全球顶尖安全专家,开发了OpenClaw Enterprise版本,基于OpenShell安全技术,配备策略引擎、网络护栏和隐私路由器,打造了企业级安全的参考架构,我们将其命名为NemoClaw,可直接下载使用。

英伟达开放模型计划

英伟达已在每个AI领域的前沿模型上确立了领导地位:

模型 | 领域 |

|---|---|

Nemotron | 大型语言模型 |

Cosmos | 世界基础模型 |

GROOT | 通用机器人模型 |

Alpamayo | 自动驾驶 |

BioNeMo | 数字生物学/药物发现 |

PhysicsNeMo | AI物理仿真 |

今天,我们正式宣布成立Nemotron联盟,与以下公司合作共同打造Nemotron 4:

BlackForest Labs(图像生成)

Cursor(代码编辑)

LangChain(自定义Agent构建框架,十亿次下载)

Mistral(开源大模型)

Perplexity(AI搜索)

Reflection(多模态Agentic系统)

Sarvam(印度AI公司)

Thinking Machines(Mira Murati创立的实验室)

这些公司正在与我们合作,共同将NemoClaw参考设计、英伟达 Agentic AI工具包以及全系列开放模型深度集成到各自的产品与服务中。

物理AI与机器人

除数字Agent之外,我们长期致力于物理AI与机器人领域。

我们为机器人系统打造了三台关键计算机:

训练计算机

合成数据生成与仿真计算机

机器人本体内置计算机

我们与Siemens、Cadence等众多合作伙伴深度集成,并宣布了一系列重大合作:

自动驾驶领域: 自动驾驶的"ChatGPT时刻"已经到来。今天,我们宣布四家全新RoboTaxi合作伙伴:比亚迪、现代、日产、吉利,加上之前的奔驰、丰田、通用,每年合计生产1800万辆汽车,全面接入英伟达 RoboTaxi Ready平台。同时,我们宣布与Uber达成重大合作,将在多个城市部署RoboTaxi车辆并接入其网络。

工业机器人领域: 我们与ABB、Universal Robots、KUKA及卡特彼勒等众多工业机器人公司合作,将物理AI模型与仿真系统整合部署至全球制造产线。

电信领域: T-Mobile也出现在这里——未来的无线基站将演变为英伟达 Aerial AI RAN,能够动态推理流量、自适应调整波束赋形,在提升信号质量的同时显著节省能耗。

最后,我们展示了与迪士尼联合开发的"奥拉夫"机器人——基于Jetson计算平台、Omniverse训练环境,以及与迪士尼、DeepMind联合开发的Newton物理求解器(运行于英伟达 Warp之上),实现了真实物理世界中的自适应运动。这是物理AI的精彩呈现,也是未来主题公园的生动预演。

总结

本次GTC,我们围绕四大核心主题展开:

推理拐点——AI从"能理解"到"能生成"到"能推理"再到"能工作"的跃迁,计算需求暴增百万倍,推理拐点正式到来;

AI工厂——数据中心正在从存储文件的"数据中心"演变为生产Token的"AI工厂",Vera Rubin将在每一服务层级实现约5倍的收益提升;

OpenClaw与Agent革命——企业IT正在经历深刻变革,每家公司都必须制定Agent战略,NemoClaw提供了安全可用的参考设计;

物理AI与机器人——自动驾驶、工业机器人、人形机器人,物理AI的时代已经到来。

祝大家GTC愉快,谢谢!

免责声明:本文章仅代表作者个人观点,不代表本平台的立场和观点。本文章仅供信息分享,不构成对任何人的任何投资建议。用户与作者之间的任何争议,与本平台无关。如网页中刊载的文章或图片涉及侵权,请提供相关的权利证明和身份证明发送邮件到support@aicoin.com,本平台相关工作人员将会进行核查。