软件开发人员以孩子发现糖果的热情接受人工智能工具,但他们对这些工具的输出信任程度与对政治家承诺的信任程度相当。

谷歌云的2025年DORA报告,周三发布,显示90%的开发人员现在在日常工作中使用人工智能,比去年增加了14%。

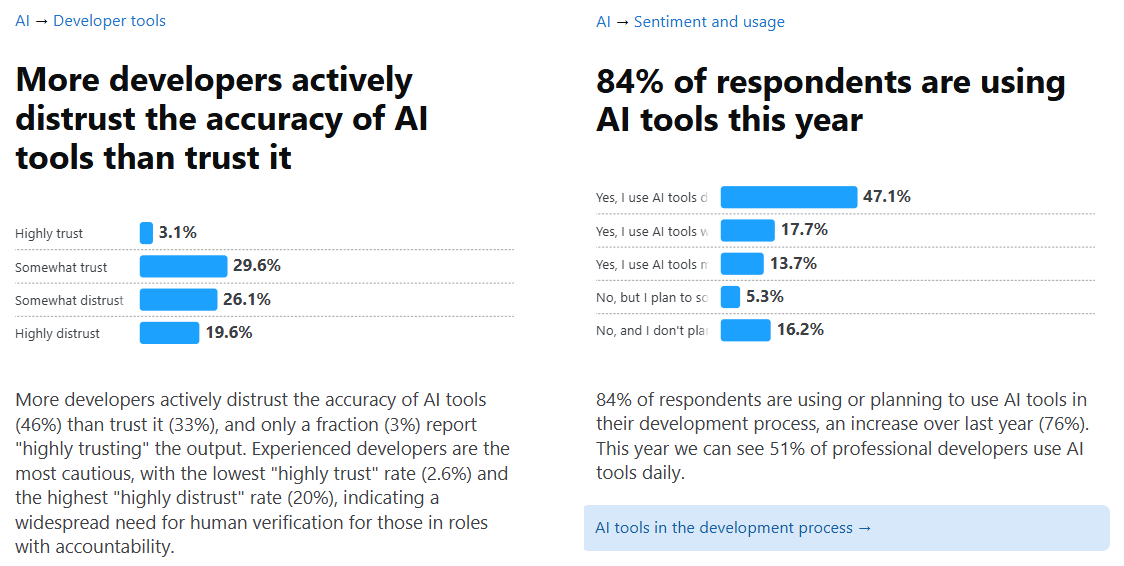

报告还发现,只有24%的受访者实际上信任这些工具生成的信息。

这项年度研究调查了近5000名全球技术专业人士,描绘了一个试图快速前进而不破坏事物的行业图景。

开发人员每天平均花费两小时与人工智能助手合作,将其整合到从代码生成到安全审查的各个方面。然而,这些专业人士中有30%对人工智能的输出要么“有点信任”,要么“完全不信任”。

“如果你是谷歌的工程师,使用人工智能作为日常工作的一部分是不可避免的,”负责谷歌编码工具(包括Gemini Code Assist)的Ryan Salva,告诉CNN。

该公司的数据显示,谷歌新代码中有超过四分之一来自人工智能系统,首席执行官Sundar Pichai 声称工程团队的生产力提高了10%。

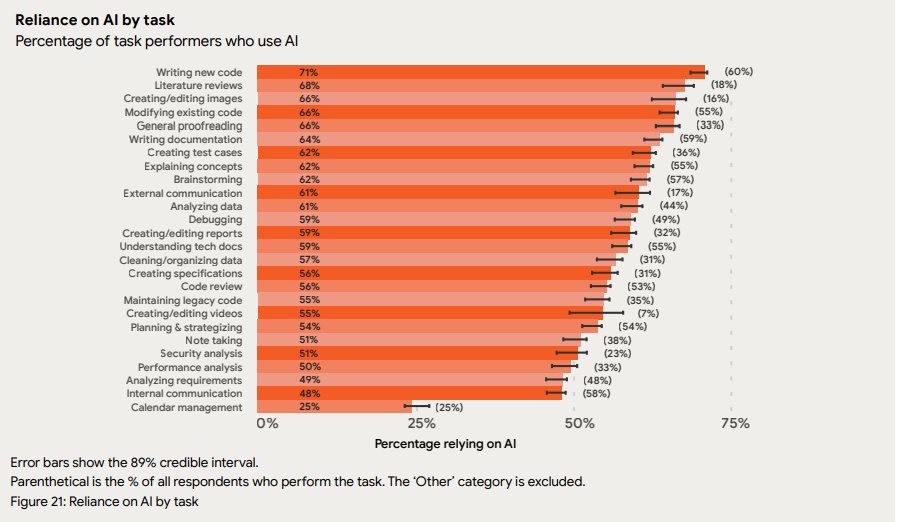

开发人员主要使用人工智能来编写和修改新代码。其他用例包括调试、审查和维护遗留代码,以及解释概念或编写文档等更具教育性的目的。

图片:谷歌

尽管缺乏信任,超过80%的受访开发人员报告称人工智能提高了他们的工作效率,而59%注意到代码质量有所改善。

然而,事情在这里变得奇怪:65%的受访者描述自己对这些工具的依赖程度很高,尽管并不完全信任它们。

在这一群体中,37%报告“适度”依赖,20%表示“非常依赖”,8%承认“极度依赖”。

这种信任与生产力的悖论与Stack Overflow的2025年调查的发现一致,尽管该年的高采用率为84%,但对人工智能准确性的怀疑在短短一年内从31%上升到46%。

开发人员将人工智能视为一个聪明但不可靠的同事——在头脑风暴和繁重工作中很有用,但一切都需要仔细核对。

图片:Stack Overflow

DORA:推动人工智能原生工作

谷歌的回应不仅仅是记录这一趋势。

周二,该公司推出了DORA人工智能能力模型,这是一个识别七种实践的框架,旨在帮助组织在不承担风险的情况下利用人工智能的价值。

该模型提倡以用户为中心的设计、明确的沟通协议,以及谷歌所称的“小批量工作流程”——本质上是避免在没有监督的情况下进行不受控的人工智能操作。

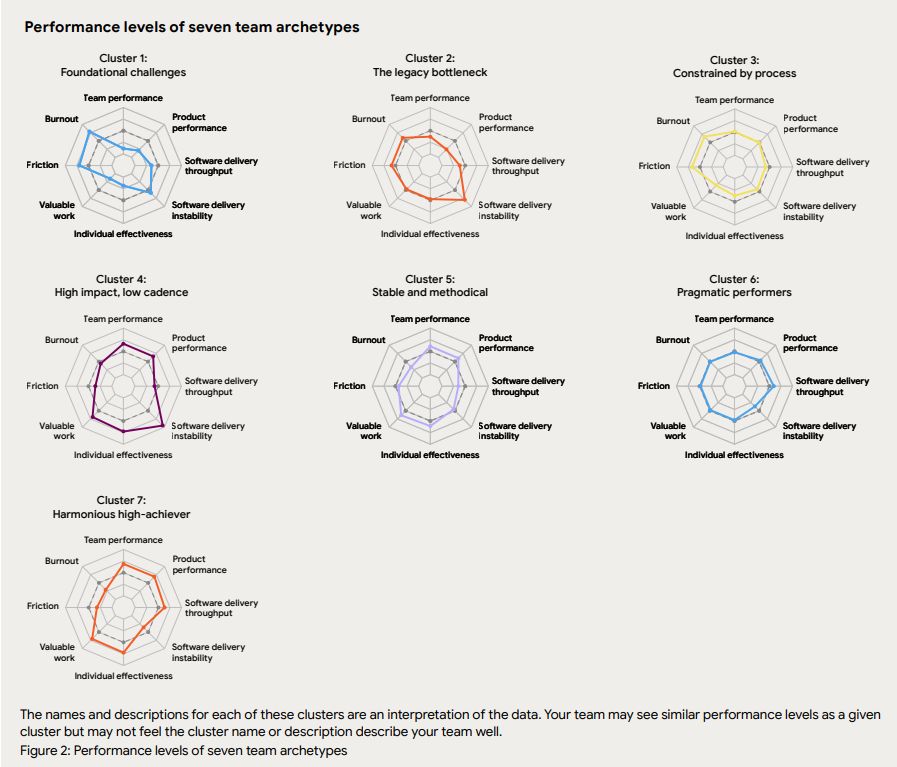

报告还介绍了从“和谐的高成就者”到陷入“遗留瓶颈”的团队原型。

这些档案源于对不同组织如何处理人工智能集成的分析。拥有强大现有流程的团队看到人工智能放大了他们的优势。分散的组织则目睹人工智能暴露了他们工作流程中的每一个弱点。

图片:谷歌

完整的人工智能辅助软件开发状态报告和配套的DORA人工智能能力模型文档可通过谷歌云的研究门户获取。

这些材料包括针对希望在人工智能技术采用中更加积极主动的团队的指导——前提是任何人都足够信任它们以实施。

免责声明:本文章仅代表作者个人观点,不代表本平台的立场和观点。本文章仅供信息分享,不构成对任何人的任何投资建议。用户与作者之间的任何争议,与本平台无关。如网页中刊载的文章或图片涉及侵权,请提供相关的权利证明和身份证明发送邮件到support@aicoin.com,本平台相关工作人员将会进行核查。